How to Talk to a Robot / Come parlare con un robot

How to Talk to a Robot / Come parlare con un robot

Segnalato dal Dott. Giuseppe Cotellessa / Reported by Dr. Giuseppe Cotellessa

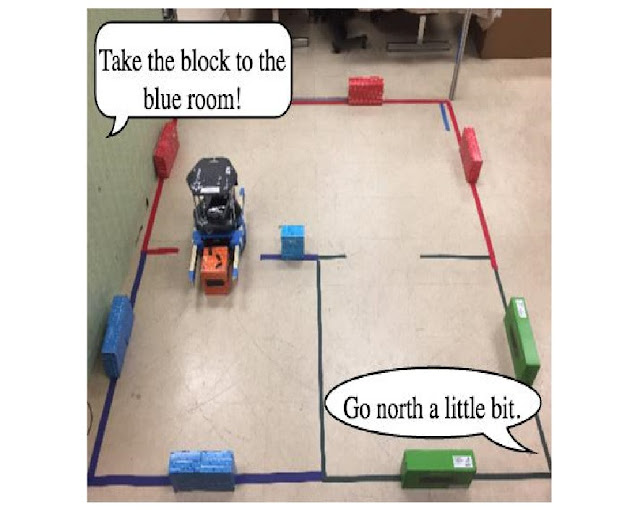

A new software system allows robots to better interpret instructions given at varying levels of specificity. (Credit: Tellex Lab/Brown University)

Un nuovo sistema software consente ai robot di interpretare meglio le istruzioni date a diversi livelli di specificità.

Generally speaking, robots respond to spoken human language by identifying cues in commands and sentence structures. They infer the desired action, which triggers an algorithm.

But consider the varying levels of specificity involved in communication. Someone working in a warehouse alongside a robotic forklift might say, “Grab that pallet.” The command is highly abstract, implying a number of smaller sub-steps – lining up the lift, putting the fork underneath, hoisting it up. Other commands, such as “Tilt the fork back a little,” are far more specific. If the robot is unable to take the level of specificity into account, it might overplan for simple instructions, or underplan for more complex ones.

A new system based on research by Brown University computer scientists is designed to address that very problem. As presented at the Robotics: Science and Systems 2017 conference in Boston, the system adds an additional level of sophistication to existing robot language models. In addition to simply inferring a desired task, the system also analyzes the language to infer a distinct level of abstraction.

The researchers used a virtual task domain called Cleanup World and Mechanical Turk, Amazon's crowdsourcing marketplace, to develop the new model. The online domain consists of a few color-coded rooms, a robotic agent and an object to be manipulated. By using a chair as the object, Mechanical Turk volunteers watched the robot agent perform a task in the virtual domain; they were then asked to list the instructions they would have given to get the robot to perform the task they’d just witnessed.

The volunteers were guided as to which of three levels of specificity their instructions should contain. At the high level, for example, an instruction might simply be, “Take the chair to the blue room.” At the stepwise-level, that same instruction might read, “Take five steps north, turn right, take two more steps, get the chair, turn left, turn left, take five steps south." A third level of abstraction used terminology in between those two.

The researchers then used those instructions to train their system as to what kinds of words are used at each level – enabling the system to adjust its hierarchical planning algorithm accordingly. They tested it in Cleanup World as well as in the physical world, with a Roomba-like robot operating in a similar space. When the robot was able to infer both the task and the specificity of the instructions, it responded to commands in one second 90 percent of the time. By contrast, when no level of specificity was inferred, 50% of the tasks required 20 seconds or more of planning time.

The work was done in the lab of Brown computer science professor Stefanie Tellex, who specializes in human–robot collaboration. "We ultimately want to see robots that are helpful partners in our homes and workplaces," she said. “This work is a step toward the goal of enabling people to communicate with robots in much the same way that we communicate with each other."

ITALIANO

In generale, i robot rispondono al linguaggio umano parlato individuando segnali nei comandi e nelle strutture di frasi. Esse deducono l'azione desiderata, che attiva un algoritmo.

Ma prendi in considerazione i diversi livelli di specificità coinvolti nella comunicazione. Qualcuno che lavora in un magazzino a fianco di un carrello elevatore robotico potrebbe dire: "afferra quel pallet". Il comando è estremamente astratto, implicando una serie di sottopassi più piccoli - allineando l'ascensore, mettendo la forcella sotto, sollevandola. Altri comandi, come ad esempio "ribaltare la forcella un po '", sono molto più specifici. Se il robot non è in grado di prendere in considerazione il livello di specificità, potrebbe sovrapporsi per semplici istruzioni o sottoprogrammi per quelli più complessi.

Un nuovo sistema basato sulla ricerca degli scienziati informatici della Brown University è stato progettato per affrontare questo problema. Come presentato alla conferenza di Robotics: Science and Systems 2017 a Boston, il sistema aggiunge un ulteriore livello di sofisticazione ai modelli di linguaggio robot esistenti. Oltre a semplicemente dedurre un compito desiderato, il sistema analizza anche la lingua per dedurre un livello distinto di astrazione.

I ricercatori hanno utilizzato un dominio di attività virtuale denominato Cleanup World e Turk meccanico, il mercato di crowdsourcing di Amazon, per sviluppare il nuovo modello. Il dominio online è costituito da alcune camere a colori, da un agente robotico e da un oggetto da manipolare. Utilizzando una sedia come oggetto, i volontari del meccanico Turk hanno osservato che l'agente robot svolge un compito nel dominio virtuale; a loro è stato chiesto di elencare le istruzioni che avrebbero dato per ottenere che il robot svolga l'attività che avevano appena visto.

I volontari sono stati guidati a quali dei tre livelli di specificità le loro istruzioni dovrebbero appartenere. Al livello alto, ad esempio, un'istruzione potrebbe semplicemente essere: "Prendi la sedia alla stanza blu". A livello stepwise, quella stessa istruzione potrebbe essere: "Prendi cinque passi a nord, girate a destra, prendete altri due passi, Prendere la sedia, girare a sinistra, girare a sinistra, prendere cinque passi a sud ". Un terzo livello di astrazione ha usato la terminologia intermedia tra quelle due.

I ricercatori hanno poi usato queste istruzioni per addestrare il proprio sistema a quali tipi di parole vengano utilizzate ad ogni livello - consentendo al sistema di adeguare al suo algoritmo di pianificazione gerarchica di conseguenza. Lo hanno testato nel Cleanup World così come nel mondo fisico, con un robot simile a Roomba che opera in uno spazio simile. Quando il robot era in grado di dedurre sia il compito che la specificità delle istruzioni, ha risposto ai comandi in un secondo il 90 per cento del tempo. Al contrario, quando nessun livello di specificità è stato dedotto, il 50% delle attività ha richiesto 20 secondi o più del tempo di pianificazione.

Il lavoro è stato fatto nel laboratorio del professore di scienze informatiche Brown Stefanie Tellex, specializzato in collaborazione tra uomo e robot. "Alla fine vogliamo colloquiare con i robot che sono partner utili nelle nostre case e nei luoghi di lavoro", ha detto. "Questo lavoro è un passo verso l'obiettivo di consentire alle persone di comunicare con i robot in modo molto simile a quello che comunichiamo tra di loro".

Da:

http://insights.globalspec.com/article/5843/how-to-talk-to-a-robot?id=%2D1474234620&uh=f9d092&email=giuseppe%2Ecotellessa%40enea%2Eit&md=170728&mh=a469c8&Vol=Vol12Issue7&Pub=46&LinkId=1876672&keyword=link%5F1876672&et_rid=1808050309&et_mid=83509632&frmtrk=newsletter&cid=nl

Commenti

Posta un commento